Deepfake: आसान नहीं है डीपफेक को रोक पाना

Deepfake: एक फेक वीडियो राष्ट्रीय चर्चा का विषय भी बन सकता है यह सुनने में थोड़ा अजीब लग सकता है, लेकिन हाल ही में हमने इसे वास्तविकता में बदलते देखा है। अभिनेत्री रश्मिका मंधाना के वायरल वीडियो के मामले में उनका आहत महसूस करना, अमिताभ बच्चन का इसे लेकर पोस्ट करना और एक्शन लेने की मांग करना एक बेहद स्वाभाविक सी बात है।

इसके बाद केंद्रीय सूचना प्रौद्योगिकी राज्य मंत्री राजीव चंद्रशेखर ने इंटरनेट उपयोगकर्ताओं की सुरक्षा और भरोसा सुनिश्चित करने को लेकर केंद्र सरकार की प्रतिबद्धता दोहराई तो लगा कि मामले में बिग बी के दखल की वजह से वह एक औपचारिकता प्रदर्शित कर रहे हैं। लेकिन, जिस तेजी से सूचना प्रौद्योगिकी मंत्रालय हरकत में आया और आनन-फानन में इसे लेकर एडवाइजरी जारी की, वह और भी आश्चर्यजनक है।

लेकिन यह समस्या ऐसे 'फर्स्टएड' शैली में पेश किए गए फौरी समाधान से हल होने वाली नहीं है। वैसे भी एडवाइजरी के अनुसार सोशल मीडिया प्लेटफॉर्मों को इस तरह की सामग्री हटाने के लिए 24 घंटों का समय दिया गया है। एक ऐसी दुनिया, जहॉं सेकेंडों में कोई कंटेंट लाखों-करोड़ों लोगों द्वारा शेयर और री-पोस्ट कर दिया जाता है, 24 घंटों में संबंधित पक्ष को इतनी ज्यादा क्षति पहुँच चुका होता है कि फिर उस कंटेंट के ऑनलाइन रहने या न रहने से कोई बहुत फर्क नहीं पड़ेगा।

इसका अंदाजा इसी बात से लगाया जा सकता है कि एडवाइजरी जारी होने के कुछ ही घंटों के भीतर डीपफेक का एक और नया मामला सामने आ गया। इस बार शिकार कैटरीना कैफ हुई हैं, जिनकी आने वाली फिल्म टाइगर-3 के ट्रेलर की एक क्लिप के साथ छेड़छाड़ की गई है। मंधाना के वीडियो में चेहरा बदला गया था, इसमें कैटरीना की ड्रेस बदल दी गई है।

बेशक इससे पहले इस तरह की चर्चा इस स्तर तक न पहुँची हो, लेकिन मशहूर हस्तियों के साथ इस तरह की शर्मनाक हरकतें पहले भी बहुत बार होती रही हैं। उससे भी बहुत पहले से जब डीपफेक नामक यह टर्म चलन में नहीं आया था। वीडियो में फेस मार्फिंग कर, मशहूर हस्तियों की छवि खराब करने का यह सिलसिला, करीब तीन दशकों से भी ज्यादा लंबे समय से जारी है। समय के साथ, बस इसमें यही बदलाव आया है कि पहले थोड़ा सा ध्यान से देखने पर समझ में आ जाता था कि वीडियो असली नहीं है। लेकिन, अब इस तकनीक में आर्टिफिशियल इंटेलिजेंस के प्रवेश ने इसे बहुत उन्नत कर दिया है और हालत यह है कि अच्छे अच्छे जानकारों के लिए असल और नकल में फर्क कर पाना मुश्किल हो जाता है।

2019 में यूएस हाउस ऑफ रिप्रेजेंटेटिव्स की स्पीकर नैंसी पोलेसी, 2020 में हॉलीवुड स्टार टॉम क्रूज, 2021 में पूर्व अमेरिकी राष्ट्रपति बराक ओबामा, 2022 में एलन मस्क, इसी साल टॉम हैंक्स, क्रिस्टीना बेल्स जैसी हस्तियॉं और हमारे यहॉं प्रियंका चोपड़ा, अनुष्का शर्मा, कियारा आडवाणी, तमन्ना भाटिया, पूजा हेगड़े आदि इसका शिकार बन चुकी हैं।

सोचिए, ऐसे में आम आदमी का क्या हाल होगा। हस्तियों के मामले चर्चित हो जाते हैं, क्योंकि समाज और मीडिया उन्हें लेकर बहुत संवेदनशील होता है। लेकिन, गुमनाम लोगों को मिली यह अनचाही बदनामी, उन्हें कहीं का नहीं छोड़ती। 2019 में सेंसिटी एआई ने एक रिसर्च की, जिसके अनुसार 96% डीपफेक छवियॉं पोर्न होती हैं, जिनमें 99% महिलाएं होती हैं। जाहिर है, इनमें अधिकतर ऐसे ही लोग शिकार बनते हैं, जो हाशिए पर रहते हुए जीवन गुजार रहे होते हैं।

क्या है डीपफेक? (What is deepfake)

डीपफेक शब्द, डीप लर्निंग और फेक को मिलाकर बना है। डीप लर्निंग कृत्रिम बुद्धिमत्ता का एक प्रकार है, जो डाटा से सीखने के लिए आर्टिफिशियल न्यूरल नेटवर्कों का इस्तेमाल करती है। इस शब्द को वर्ष 2017 में एक रेडिट यूजर ने इस्तेमाल किया था, जिसने इसी नाम से अपना अकाउंट बनाया हुआ था। वह ओपेन सोर्स फेस-स्वैपिंग टेक्नोलॉजी का इस्तेमाल कर अश्लील वीडियो तैयार और साझा किया करता था। यह तेजी से लोकप्रिय होता गया और आज इसे हर उस सिंथेटिक कंटेंट के लिए प्रयोग किया जाता है, जिसे एआई का इस्तेमाल करके बनाया गया हो। ऑडियो और वीडियो में यह टेक्नोलॉजी तेजी से लोकप्रिय होती गई। नौबत यहॉं तक आ पहुँची कि 2019 में पहली बार एक ऐसी प्रतियोगिता आयोजित की गई, जिसमें प्रतिभागियों को डीपफेक की पहचान करनी थी।

हर टेक्नोलॉजी की तरह डीपफेक तकनीक भी एक दोधारी तलवार की तरह है, जिसके फायदे और नुकसान दोनों हैं। मनोरंजन, संचार, शिक्षा और अनुसंधान जैसे क्षेत्रों में डीपफेक का उपयोग विकास को नए आयाम दे सकता है। लेकिन वहीं इस तकनीक का उपयोग दुर्भावनापूर्ण उद्देश्यों के लिए भी किए जाने के पूरे खतरे हैं। इसका उपयोग फर्जी समाचार वीडियो बनाने, या नकली ऑडियो रिकॉर्डिंग तैयार कर उसके जरिए लोगों को नुकसान पहुँचाने या ब्लैकमेलिंग में किया जा सकता है।

एआई और डीपफेक की घातक जुगलबंदी

अभी तो डीपफेक विकास के शुरुआती दौर में ही है और अभी से इसकी पहचान और रोकथाम में इतनी सारी चुनौतियों का सामना करना पड़ रहा है। आने वाले वर्षों में जब यह आज से कई गुना ज्यादा उन्नत हो चुका होगा, इसे नियंत्रित कर पाना लगभग असंभव ही होगा। बेशक ऐसे बहुत सारे टूल्स डेवलप किए जा रहे हैं, जो इस काम में हमारे मददगार साबित होंगे। लेकिन, एआई जिस तरह से तेजी से विकसित हो रहा है, उसे देखते हुए इन टूल्स की सटीकता या सफलता को लेकर बहुत अधिक आश्वस्त नहीं हुआ जा सकता।

इस डर की वजह यह है कि एआई के साथ डीपफेक की जुगलबंदी ने इसे पहले की तुलना में कई गुना ज्यादा वास्तविक, सुगम बना दिया है और हर किसी की पहुँच के दायरे में ला दिया है। इसके अलावा, डीप लर्निंग अलगोरिदम भी लगातार विकसित हो रहा है, जिसकी वजह से डीपफेक्स और अधिक ताकतवर और खतरनाक होते जाएंगे।

वह दिन दूर नहीं, जब डीपफेक की मदद से ऐसा सिंथेटिक मीडिया तैयार कर पाना संभव होगा, जिसे असली मीडिया से अलग कर पाना संभव नहीं होगा। ऐसे में उसके जरिए दुष्प्रचार और गलत सूचनाओं के प्रसार का खतरा बढ़ जाएगा। इससे समाज में एक घातक किस्म की अस्थिरता की स्थिति उत्पन्न हो सकती है। यूरोपोल (यूरोपियन इंटरनेशनल पुलिस) ने चेतावनी दी है कि 2026 तक 90% कंटेंट सिंथेटिक होगा।

अब सवाल यह है कि इस स्थिति का सामना करने के लिए हमारी क्या तैयारियॉं हैं? सोशल मीडिया के लिए एडवाइजरी जारी करना, क्या इसके लिए पर्याप्त होगा? हद से हद, यहॉं भी एक स्वनियमन की व्यवस्था लाई जा सकती है। उसकी विफलता हम न्यूज चैनलों और ओटीटी प्लेटफॉर्मों के मामलों में देख ही चुके हैं। एक ऐसा देश, जो आने वाले वर्षों में कृत्रिम बुद्धिमत्ता के क्षेत्र में ग्लोबल लीडर बनने की महत्वाकांक्षा लेकर आगे बढ़ रहा हो, इसके डीपफेक जैसे बायप्रॉडक्ट्स के दुष्प्रभावों से कैसे और कब तक बचा रह सकता है?

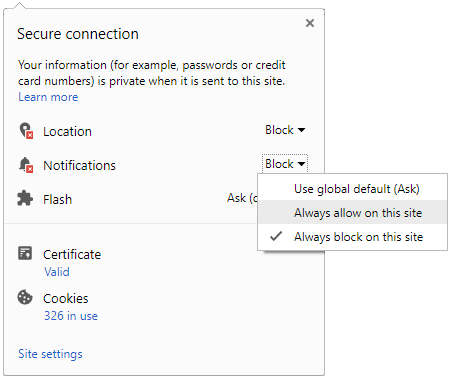

Click it and Unblock the Notifications

Click it and Unblock the Notifications