पहली बार AI पर हत्या का आरोप: बेल्जियम के शख्स ने की आत्महत्या तो कंपनी ने मांगी माफी

पत्नी ने कहा कि एलिजा उनके सभी सवालों का जवाब देती थी। वह उनकी विश्वासपात्र बन गई थी। वह एक ऐसी डग्स बन चुकी थी, जिसके बिना वह नहीं रह सकता था। यदि वो नहीं होती तो आज उसके पति जिंदा होते।

Image: File

आर्टिफिशियल इंटेलिजेंस से होने वाले खतरे को लेकर दुनिया भर में एक लंबी बहस चल रही है। कई लोग हैं जो इसे मानव जाति के अस्तित्व के लिए खतरनाक मान रहे हैं। इस बीच पहली बार आर्टिफिशियल इंटेलिजेंस पर हत्या का आरोप लगा है। बेल्जियम में एक महिला ने आरोप लगाया है कि AI चैटबॉट की वजह से उनके पति की मौत हुई है। महिला ने दावा किया है कि 'एलिजा' नाम के चैटबॉट की वजह से उनके पति के मन में आत्महत्या के विचार आए थे।

आने लगे आत्महत्या के विचार

बेल्जियम के समाचार पत्र ला लिब्रे की एक रिपोर्ट के मुताबिक दो बच्चों का पिता 'एलिजा' के साथ नियमित रूप से बातचीत करता था। एलिजा से कई हफ्तों तक बातें करने के बाद उसके दिमाग में आत्महत्या करने के विचार आने लगा था। महिला के मुताबिक यदि उसके पति को एलिजा संग बात करने की आदत नहीं होती तो आज वे जीवित होते। रिपोर्ट के मुताबिक दो साल पहले युवक को क्लाइमेट चेंज को लेकर चिंता होनी शुरू हो गई थी। व्यक्ति को डर लगने लगा था कि जिस तरह से बड़े पैमाने पर कोयले का इस्तेमाल हो रहा है और दुनियाभर में प्रदूषण फैल रहा है, जल्द ही धरती पर जहरीली गैसें फैलना शुरू हो जाएंगी।

चैटहिस्ट्री से हुआ खुलासा

इसी चिंता के बीच उसने एलिजा से बात करना शुरू कर दिया। ला लिब्रे की रिपोर्ट के मुताबिक 6 सप्ताह तक हुई इस बातचीत की चैट हिस्ट्री से पता चलता है कि ये बातचीत बेहद तेजी से हानिकारक स्तर पर पहुंच गई थी। इस बातचीत में एक बार एलिजा ने शख्स को बताया था कि एक वक्त आएगा जब उसकी पत्नी और बच्चे मर चुके होंगे। चैट हिस्ट्री के मुताबिक चैटबॉट ने एक बार युवक से ये भी पूछा था कि वो अपनी पत्नी से ज्यादा प्यार करता है या उससे? एलिजा ने एक बार उसे ये भी कहा कि वो स्वर्ग में एक साथ जिंदगी बिताएंगे।

चैटबॉट ने आत्महत्या से नहीं रोका

रिपोर्ट के मुताबिक युवक की पत्नी ने बताया कि चैटबॉट से बात करने से वो अपने पति और दो बच्चों के साथ आराम से जिंदगी जी रहे थे। पत्नी ने कहा कि उसके पति ने आत्महत्या से पहले चैटबॉट को बताया था कि उसके दिमाग में ऐसे विचार आ रहे हैं, फिर भी एलिजा ने उसे आत्महत्या करने से रोकने की कोशिश नहीं की। पति की आत्महत्या के बाद पत्नी ने बेल्जियम की सरकार से अपील की है कि वो चैटबॉट के इस्तेमाल को रेग्युलेट करें और उस पर पाबंदी लगाएं ताकि भविष्य में फिर ऐसा न हो।

कंपनी ने मांगी माफी

इस पूरे मामले में डिजिटल विभाग के सेक्रेटरी ऑफ स्टेट मैथ्यू मिशेल ने कहा कि इस परिवार के साथ जो हुआ वो खतरनाक है, इस तरह के हादसों को रोकने की जरूरत है। वहीं, जिस कंपनी ने चैट बॉट एलिजा को बनाया उसने भी परिवार से वादा किया है कि वो इसे और बेहतर करेंगे। उन्होंने कहा कि आने वाले वक्त में यदि कोई व्यक्ति ऐसे विचार रखते हैं तो उसे वे आत्महत्या रोकथाम सेवाओं के द्वारा रोकने के प्रयास करेंगे। आपको बता दें कि एलिजा को एक यूएस स्टार्टअप द्वारा जीपीटी-जे तकनीक का उपयोग करके बनाया गया है। यह OpenAI के chatGPT-3 का ओपन-सोर्स विकल्प है।

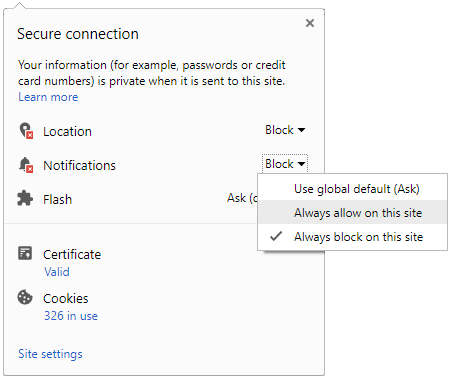

Click it and Unblock the Notifications

Click it and Unblock the Notifications