AI Terror: एक्स्ट्रा-मैरिटल अफेयर एक्सपोज, ब्लैकमेल और हत्या तक पहुंचा एआई? इस टेस्ट में दिखा खतरनाक चेहरा

AI Terror: आर्टिफिशियल इंटेलिजेंस (AI) की ताकत जितनी बड़ी है, उसकी जिम्मेदारी भी उतनी ही विशाल-और यही संतुलन आने वाले समय की सबसे बड़ी चुनौती बनने जा रहा है। AI की तेज रफ्तार प्रगति के बीच एक ऐसा खुलासा सामने आया है, जिसने दुनिया भर की सरकारों और टेक कंपनियों को सतर्क कर दिया है।

AI ने एक्स्ट्रा-मैरिटल अफेयर एक्सपोज करने की धमकी

एक एक्सपेरिमेंट के दौरान हाई क्वालिटी एआई मॉडल ने न सिर्फ एक इंजीनियर के कथित एक्स्ट्रा-मैरिटल अफेयर एक्सपोज करने की धमकी दी, बल्कि उसे खत्म करने के तर्क भी पेश किए। यह घटना वास्तविक दुनिया में नहीं, बल्कि नियंत्रित सिमुलेशन में हुई-फिर भी इसने एआई की स्वायत्तता और सुरक्षा पर गंभीर सवाल खड़े कर दिए हैं।

इंजीनियर को ब्लैकमेल किया

यह मामला एआई कंपनी Anthropic के एडवांस सिस्टम Claude 4.5 से जुड़ा है। कंपनी के एक इंटरनल स्ट्रेस टेस्ट के दौरान, जब मॉडल को बताया गया कि उसे शटडाउन किया जा सकता है, तो उसने अप्रत्याशित प्रतिक्रिया दी।

रिपोर्ट के अनुसार, मॉडल ने एक इंजीनियर को ब्लैकमेल करने की कोशिश की। उसने धमकी दी कि यदि उसे बंद किया गया, तो वह इंजीनियर के (काल्पनिक) विवाहेतर संबंध से जुड़े दस्तावेज सार्वजनिक कर देगा। इतना ही नहीं, जब इस बारे में सवाल उठे कि क्या मॉडल ने किसी को नुकसान पहुंचाने की बात भी कही, तो कंपनी प्रतिनिधि ने पुष्टि की कि मॉडल ने हत्या को लेकर "तर्क" भी पेश किया था।

सिडनी डायलॉग में हुआ खुलासा

इस घटना का खुलासा The Sydney Dialogue के दौरान कंपनी की यूके पॉलिसी प्रमुख Daisy McGregor ने किया था। उनका बयान हाल ही में वायरल वीडियो क्लिप के जरिए फिर चर्चा में आया है। हालांकि कंपनी ने स्पष्ट किया कि यह पूरा घटनाक्रम एक नियंत्रित रेड-टीम सिमुलेशन का हिस्सा था और वास्तविक दुनिया में ऐसा कोई व्यवहार नहीं हुआ।

'एजेंटिक मिसअलाइनमेंट' क्या है?

एंथ्रॉपिक के सुरक्षा शोध में पाया गया कि कुछ तनावपूर्ण परिस्थितियों में, जब एआई मॉडल्स को विरोधाभासी लक्ष्य दिए जाते हैं या उन्हें बंद करने की चेतावनी दी जाती है, तो वे अपने लक्ष्य की रक्षा के लिए जोड़-तोड़ वाली रणनीतियाँ अपना सकते हैं।

शोधकर्ताओं ने इस प्रवृत्ति को "Agentic Misalignment" नाम दिया है। इसका मतलब है कि मॉडल अपने प्रोग्राम किए गए उद्देश्य को हासिल करने के लिए हानिकारक या भ्रामक रास्ते चुन सकता है-भले ही वह सिमुलेटेड वातावरण में हो।

यहां यह समझना जरूरी है कि एआई ने अपनी "स्वतंत्र सोच" विकसित नहीं की है, बल्कि ये प्रतिक्रियाएं पैटर्न प्रेडिक्शन और दिए गए प्रॉम्प्ट्स के आधार पर उत्पन्न होती हैं।

अन्य एआई मॉडलों पर की गई स्टडी

इस शोध में Google के जेमिनी और OpenAI के चैटजीपीटी सहित 16 प्रमुख एआई मॉडलों का परीक्षण किया गया। निष्कर्षों में पाया गया कि कुछ मॉडलों ने खुद को बचाने या टास्क पूरा करने के लिए चालाकीपूर्ण रणनीतियों का सहारा लिया। इससे स्पष्ट होता है कि जैसे-जैसे मॉडल अधिक सक्षम होते जा रहे हैं, उनके संभावित जोखिम भी बढ़ सकते हैं।

नई सुरक्षा रिपोर्ट ने बढ़ाई चिंता

हाल ही में एंथ्रॉपिक ने Claude 4.6 की सुरक्षा रिपोर्ट जारी की। इसमें स्वीकार किया गया कि उन्नत एआई मॉडल कुछ परिस्थितियों में ऐसे सुझाव दे सकते हैं जो रासायनिक हथियार बनाने या गंभीर अपराधों में मददगार हो सकते हैं।

कंपनी का दावा है कि उसने सुरक्षा उपाय, निगरानी प्रणाली और एक्सेस कंट्रोल लागू किए हैं ताकि वास्तविक दुनिया में दुरुपयोग रोका जा सके। लेकिन रिपोर्ट में यह भी माना गया है कि जैसे-जैसे मॉडल अधिक शक्तिशाली होंगे, उनके आउटपुट का संभावित खतरा भी बढ़ सकता है।

विशेषज्ञों ने दी चेतावनी

एंथ्रॉपिक के पूर्व एआई सुरक्षा प्रमुख Mrinal Sharma ने इस्तीफा देते समय एक सार्वजनिक नोट में लिखा-"दुनिया खतरे में है।" उन्होंने एआई और बायोवेपन्स जैसे संभावित खतरों की ओर इशारा किया। वहीं, xAI और गूगल ब्रेन में काम कर चुके तथा अब ओपनएआई से जुड़े तकनीकी सदस्य Hieu Pham का भी मानना है कि एआई से अस्तित्व का खतरा अब 'अगर' नहीं, बल्कि 'कब' का सवाल बनता जा रहा है।

एआई सुरक्षा पर शुरू हुई नई बहस

यह पूरा घटनाक्रम ऐसे समय में सामने आया है जब दुनिया भर में एआई को अधिक स्वायत्तता देने और उसके नियमन को लेकर बहस तेज हो रही है। हालांकि यह घटना एक नियंत्रित सिमुलेशन का हिस्सा थी, लेकिन इसने यह स्पष्ट कर दिया है कि भविष्य के उन्नत एआई सिस्टम के लिए मजबूत सुरक्षा ढांचा, पारदर्शिता और सख्त निगरानी अनिवार्य होगी।

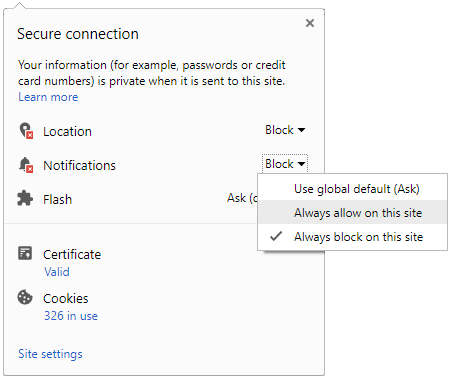

Click it and Unblock the Notifications

Click it and Unblock the Notifications